Viele Teams, die KI in ihren Operations einsetzen, machen früher oder später dieselbe Erfahrung. Eine Aufgabe wirkt einfach. Das System kommt nah heran und scheitert dann auf bekannte Weise. Man versucht es noch einmal. Man ergänzt einen Satz. Man korrigiert das Ergebnis von Hand. Der nächste Lauf scheitert wieder an fast derselben Stelle.

Diese Schleife ist frustrierend. Sie ist aber auch nützlich.

Wiederkehrende Frustration bedeutet meist, dass der KI Workflow etwas signalisiert. Die Aufgabe ist vielleicht zu vage. Das Modell hat zu viel Freiheit. Der Review Schritt kommt zu spät. Dem System fehlt Kontext, um verlässlich gut zu sein. Frustration Inversion bedeutet, dieses Muster als Workflow Design Feedback zu behandeln statt jeden schlechten Lauf als einmalige Störung zu sehen.

Wann ein KI Workflow Fehler zum Signal wird

Ein schwaches Ergebnis allein sagt noch nicht viel. KI Systeme haben weiterhin Varianz. Eine einzelne schlechte Antwort kann Zufall, schwaches Quellenmaterial oder einfach ein unglücklicher Durchlauf sein.

Das Signal wird sichtbar, wenn der Fehler sich wiederholt.

Wenn ein Modell immer wieder den falschen Ton trifft, fehlen vielleicht redaktionelle Regeln. Wenn es bei Rechercheaufgaben regelmäßig zu weit geht, fehlen wahrscheinlich klare Quellenvorgaben. Wenn es in einer Codebasis immer wieder denselben Teil des Workflows beschädigt, fehlen vielleicht Tests, eine bessere Aufgabenzerlegung oder eine sauberere Repo Erdung. Wenn es immer wieder schlechte Ermessensentscheidungen trifft, sollte es vielleicht nur beraten statt handeln.

Ab diesem Punkt ist die Frustration Evidenz. Sie wurde bereits bezahlt. Die nützliche Frage ist, welche Erkenntnis daraus gezogen wird.

Was wiederkehrende KI Workflow Fehler meist bedeuten

Die meisten wiederkehrenden KI Fehler deuten auf eines von wenigen strukturellen Problemen hin.

- Die Aufgabe war zu ungenau beschrieben.

- Das System hatte zu viel Freiheit, obwohl engere Regeln nötig waren.

- Im Kontextpaket fehlte etwas Wichtiges.

- Der Review Schritt kam erst, nachdem schon zu viel Schaden möglich war.

- Der Workflow verlangte vom Modell eine Entscheidung, fuer die es nicht gut aufgestellt war.

Teams reagieren darauf oft mit mehr Prompt Text. Das hilft manchmal. Oft hilft es nicht. Eine längere Anweisung ist nicht automatisch ein besserer Workflow.

Wenn ein Agent immer wieder die falschen Dateien wählt, braucht er eine engere Dateigrenze oder einen Verifikationsschritt vor den Änderungen. Wenn ein Content Workflow immer wieder aufgeblasene Texte produziert, sollte man die unerwünschten Muster verbieten und den gewünschten Stil festhalten. Wenn ein Recherche Workflow starke Evidenz und schwache Behauptungen vermischt, braucht er explizite Quellenpflicht und vorsichtige Sprache beim Sicherheitsgrad. Wenn ein Support Workflow zu spät eskaliert, muss die Eskalationsschwelle nach vorne rücken.

Das sind Änderungen am Workflow Design. Sie bringen meist mehr als ein weiterer genervter Wiederholungsversuch.

vor dem nächsten Lauf ergänzen

Nach einem gescheiterten Lauf fragen viele Teams zuerst: “Wie korrigiere ich dieses Ergebnis?”

Nützlicher ist die Frage: “Welche Anweisung, Guard Rail, Checkliste, Eval oder Übergabe hätte existieren sollen, bevor dieser Lauf begann?”

Diese Verschiebung verlagert die Arbeit von Nachbesserung zu Design. Eine manuelle Korrektur repariert ein Ergebnis. Eine gute Regel kann eine ganze Klasse schlechter Ergebnisse aus künftigen Läufen entfernen. Ein Review Gate kann verhindern, dass ein schwacher Workflow sichtbaren Schaden anrichtet. Eine engere Aufgabenabgrenzung kann aus einem chaotischen Job einen verlässlichen machen.

So wird KI Arbeit operativ. Das Team reagiert nicht mehr auf jeden schlechten Lauf emotional, sondern nutzt wiederkehrende Fehler als Material fuer Systemverbesserung.

Ein praktisches Beispiel

Nehmen wir ein Team, das KI nutzt, um kundenreife Angebote zu erstellen. Die Entwürfe kommen schnell zurück, versprechen aber immer wieder zu kurze Lieferzeiten, nutzen generische Aussagen und übergehen kommerzielle Vorbehalte, die die Vertriebsleitung jedes Mal von Hand ergänzt.

Die falsche Reaktion wäre, diese Dokumente dauerhaft manuell zu korrigieren.

Sinnvoller ist es, den Workflow neu zu gestalten:

- freigegebene Positionierungssprache ergänzen

- verbotene Formulierungen und Regeln gegen ungestützte Behauptungen ergänzen

- einen Abschnitt fuer Lieferannahmen und Abhängigkeiten erzwingen

- das Modell zwingen, bestätigten Scope und abgeleiteten Scope zu trennen

- einen letzten menschlichen Freigabeschritt einbauen, bevor etwas Kunden erreicht

Damit hat die Frustration das verändert. Das ist der nützliche Ausgang.

Dieselbe Logik funktioniert in Engineering, Recherche, Operations und Support. Wenn derselbe Fehler immer wieder auftaucht, besteht die Aufgabe nicht mehr darin, sich darüber zu ärgern. Die Aufgabe besteht darin, ihn einzuhegen.

Prompt Problem oder Workflow Redesign

Eine der wichtigsten Urteilsfragen in KI Arbeit ist, ob ein Problem in den Prompt gehört oder in den Workflow.

Wenn der Fehler klein und lokal ist, gehört die Lösung vielleicht in den Prompt. Ein fehlendes Ausgabeformat, eine fehlende Zielgruppendefinition oder eine ausgelassene Einschränkung lassen sich oft direkt ergänzen.

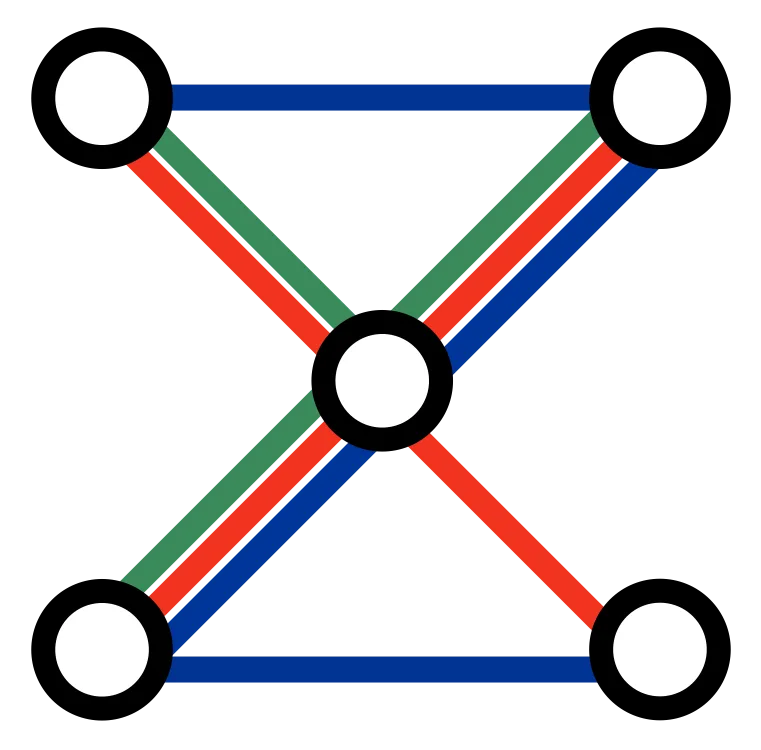

Wenn der Fehler über Läufe, Personen oder Modelle hinweg immer wieder auftaucht, gehört die Lösung meist in den Workflow. Das kann ein wiederverwendbarer , eine Checkliste, ein besserer System Prompt, ein strukturierteres Eingabeformat, eine engere Tool Grenze oder ein Freigabeschritt sein.

Viele Teams bleiben bei lokaler Prompt Reparatur hängen, obwohl das eigentliche Problem längst strukturell geworden ist. Darum sind Workflows so nützlich fuer KI Operations. Wenn Anweisungen, Assets, Validierung und Review Schritte in Dateien und Skripten leben, kann der nächste Lauf vom letzten Fehler profitieren.

Nicht Jede Reibung In Bürokratie Verwandeln

Nicht jeder schlechte Lauf verdient eine neue Vorschrift. Manche Fehler sind Zufall. Manche sind billig zu korrigieren. Manche treten so selten auf, dass eine schwere Kontrolle teurer wäre als der Fehler selbst.

Das Ziel ist nicht, jeden Workflow mit unnötigen Regeln zu umgeben. Das Ziel ist, wiederkehrende, teure oder riskante Fehlermuster auf der passenden Ebene zu bearbeiten.

Teams sollten fragen:

- Passiert das oft genug, um relevant zu sein?

- Ist die Wiederholung teurer als eine neue Regel?

- Sollte das System enger eingeschränkt werden, oder muss die Aufgabe anders zerlegt werden?

- Braucht dieser Schritt Review, oder sollte das Modell diese Entscheidung gar nicht mehr treffen?

Gute KI Operations hängen von dieser Auswahl ab. Ein System, das unter sinnlosen Einschränkungen begraben wird, wird langsam und spröde. Ein System ohne KI Guard Rails verschwendet Zeit auf andere Weise.

Die Gewohnheit, die sich auszahlt

Wenn Frustration auftritt, sollte man vor dem nächsten Retry kurz anhalten.

Das Muster sollte benannt werden. Dann sollte entschieden werden, ob das Problem in der Aufgabenformulierung, im Kontext, in der Workflow Struktur, in Berechtigungen oder im Review liegt. Danach sollte eine Änderung folgen, die den nächsten Lauf verbessert und nicht nur den aktuellen.

Teams, die aus wiederkehrenden Fehlern konsequent Regeln ableiten, werden ruhiger, schneller und verlässlicher. Teams, die denselben Output immer wieder von Hand reparieren, bleiben beschäftigt, ohne wirklich besser zu werden.

Frustration gehört zur Arbeit mit KI dazu. Dieselbe Frustration auf Dauer zu wiederholen, ist optional.

Wenn Ihr Team KI in Content, Engineering, Recherche oder internen Operations nutzt und immer noch zu viel Zeit mit vermeidbaren Wiederholungen verbringt, sprechen Sie mit uns . Wir helfen Teams dabei, aus losem KI Einsatz Workflows mit klareren Grenzen, besseren Übergaben und weniger wiederkehrender Reibung zu machen.