Fuer Leser ausserhalb der Niederlande hilft etwas Kontext. NRC ist eine der wichtigsten niederlaendischen Zeitungen. Peter Van der Meersch ist eine bekannte Fuehrungsfigur in der Medienbranche, die frueher NRC leitete und spaeter hohe Rollen innerhalb von Mediahuis in Irland innehatte. Das ist ein Grund, warum diese Geschichte ueber die niederlaendische Presse hinausging und auch in englischsprachiger Berichterstattung auftauchte.

Die Fakten des Falls sind recht klar. NRC untersuchte den Einsatz von KI durch Van der Meersch in seiner eigenen Newsletter-Arbeit und berichtete, dass fabrizierte Zitate veroeffentlicht worden waren. The Guardian berichtete dann am 20. Maerz 2026, dass Mediahuis ihn nach den NRC-Ergebnissen von seiner Fellowship-Rolle suspendiert habe und dass mehrere zitierte Personen erklaerten, sie haetten die ihnen zugeschriebenen Aussagen nie gemacht.

In seiner eigenen Reaktion schrieb Van der Meersch:

“I summarised reports using AI tools and worked from those summaries, trusting they were accurate.”

und:

“I wrongly put words into people’s mouths”

Quelle: Columbia Journalism Review und NL Times .

Die Entschuldigung von Van der Meersch ist wichtig, weil sie ein reales redaktionelles Versagen anerkennt. Gleichzeitig lag der Fehler nicht nur darin, dem Output am Ende zu sehr zu vertrauen. Unsere Lesart ist, dass der Workflow selbst zu locker angeleitet und zu schwach verifiziert war. Er hat erkennbar Tools wie ChatGPT genutzt, aber hier ist kein zu sehen, der Teile der Pruefung rund um Zitate, Behauptungen und Quellenverweise schon vor der Veroeffentlichung automatisiert haette.

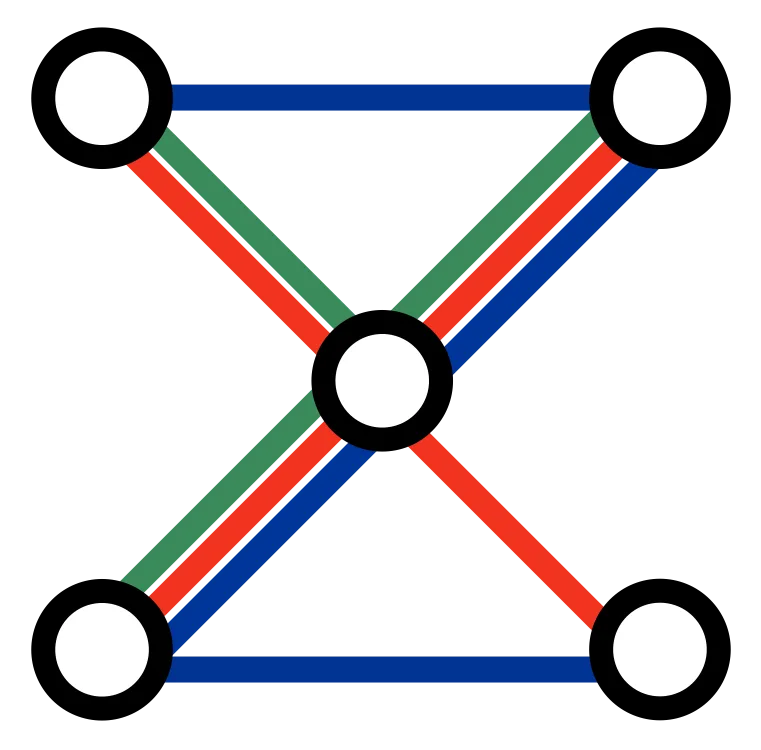

Diese Luecke ist nicht auf einen einzelnen Redakteur beschraenkt. Sie ist typisch fuer weite Teile der Nachrichtenbranche und fuer White-Collar-Arbeit insgesamt. Software Engineers sind schneller in agentische Workflows hineingewachsen und haben frueher gelernt, wichtige Arbeit unter Aufsicht, mit Logs, Tests und klaren Freigabepunkten an KI-Systeme zu delegieren. Viele andere Berufsgruppen stehen bei diesem Uebergang noch frueher.

Das Problem ist operativ. Es gab keinen verlaesslichen Loop, der den Entwurf vor der Veroeffentlichung zurueck an belastbare Belege gebunden hat. Genau deshalb lohnt es sich, solche Vorfaelle anzuschauen. Sie zeigen, an welchen Stellen ein agentischer Workflow haette helfen koennen, indem er Teile der offenbar nicht erledigten Verifikation automatisiert.

Wenn ein Team KI verantwortungsvoll einsetzen will, kann es sich nicht auf eine vage Anweisung verlassen, den Output “sorgfaeltig zu pruefen”. Das ist kein System. Ein System braucht explizite Stufen. Es braucht Regeln dafuer, was KI tun darf, was sie vorschlagen darf, was sie niemals erfinden darf und was immer auf primaeres Material zurueckgefuehrt werden muss. Es braucht strukturierte Uebergaben zwischen Entwurf und Verifikation. Es braucht auch einen harten Stopp, wenn Belege fehlen oder zu schwach sind.

und agentische Workflows sind hier relevant, weil genau dort solche Kontrolle als schriftliches Verfahren festgehalten wird. Nuetzliche Systeme sind nicht nur Drafting-Tools. Sie sind Loops mit Checks, Korrekturen und wiederholbaren Kontrollpunkten.

In einem verantwortungsvollen redaktionellen oder wissensbasierten Workflow reicht ein blosses “bitte verifizieren” nicht aus. KI hilft beim Sammeln von Quellmaterial, beim Vergleichen von Versionen, beim Entwurf von Arbeitsnotizen und bei einem ersten Durchlauf. Aber jedes Direktzitat muss seine Quelle mitfuehren: Transkript- oder Aufnahmeverweis, Name der sprechenden Person, Datum und die exakte Passage, aus der es stammt. Wenn ein generiertes Zitat nicht exakt mit dem Wortlaut der Quelle uebereinstimmt, darf es nicht als Zitat stehen bleiben. Es wird entweder zu einer paraphrasierten Aussage mit sauberer Zuschreibung oder es wird gestrichen.

Jede Tatsachenbehauptung zu Daten, Rollen, Ereignissen, Zahlen und Vorwuerfen braucht dieselbe Behandlung. Das Modell kann den Satz entwerfen, aber der Workflow muss den Beleg anhaengen, bevor der Satz ueberlebt. Ein Verifikationsschritt prueft, ob zu jedem Zitat und jeder Behauptung Belege hinterlegt sind, und alles Unbelegte wird blockiert statt fuer spaeter haengenzubleiben.

Ein finaler menschlicher Reviewer sollte nicht nur den glatten Entwurf sehen, sondern auch die Belegkette und offene Ausnahmen. Erst wenn diese Checks erfolgreich durchlaufen oder offene Punkte explizit eskaliert wurden, wird veroeffentlicht.

Das laesst sich ohne viel Zeremonie umsetzen. Ein Skill fuer redaktionelle Verifikation kann verlangen, dass das Modell jedes Direktzitat extrahiert, Quelldokument, sprechende Person und Zeitstempel oder Absatzverweis anhaengt und jede Formulierung markiert, die nicht exakt zur Quelle passt. Derselbe Skill kann verlangen, dass jeder nicht triviale Tatsachensatz einen Quellenhinweis traegt. Ein Veroeffentlichungsschritt kann die Freigabe verweigern, wenn bei Zitaten oder Behauptungen noch Belege fehlen.

Dieselbe Logik laesst sich allgemeiner auf Artikel-Workflows anwenden. Ein Publishing-Skill kann kritische Review nicht als Hoeflichkeitsrunde, sondern als Gate behandeln und diese Review mit einem expliziten Verifikationsdurchlauf fuer Zitate und Behauptungen koppeln. Die Review sollte hart, aber fair bleiben, mit Fokus auf schwache Behauptungen, unbelegte Aussagen, strukturelle Unklarheit, SEO-Unklarheit und Zeilen, die glatt klingen, aber nicht belastbar sind. Fuer einen Text wie diesen sollte diese Review auch zwei schlichte Fragen stellen: Welche Aussagen sind noch zu schwach fuer die Veroeffentlichung, und welche Zitate wurden noch nicht sauber gegen die Quelle geprueft?

So ein Setup ist nicht auf Journalismus beschraenkt. Dasselbe Muster ist wichtig in Forschung, Policy-Arbeit, Rechtspruefung, Compliance, Investorenkommunikation und internem Reporting. Ueberall dort, wo eine Organisation KI bei vertrauenssensiblen Inhalten einsetzen will, lautet die Frage ganz schlicht: Wo ist der Loop, der schlechten Output abfaengt, bevor er oeffentlich oder operativ bindend wird?

KI kann diese Arbeit schneller und effizienter machen, uebernimmt die Verantwortung aber nicht. Die letzte Verantwortung liegt weiterhin bei einem Menschen, und in der Praxis bedeutet das auch, dass am Ende weiterhin ein menschlicher Ruf auf dem Spiel steht.

Unsere Sicht ist, dass verantwortungsvolle KI-Einfuehrung genau dort beginnt. Nicht bei Hype oder pauschalen Verboten, sondern damit, die Arbeit in einen Prozess zu uebersetzen, der gesteuert, verifiziert und mit der Zeit verbessert werden kann. Genau das meinen wir mit einem agentischen Workflow.

Wenn ein Team KI verantwortungsvoll in echte Arbeitsprozesse integrieren will, stellen sich meist dieselben praktischen Fragen: Wo liegen die Belege, wer verifiziert was, und welcher Schritt kann eine Veroeffentlichung blockieren, wenn der Entwurf schneller ist als das Quellenmaterial? Genau dort werden Skills, und Review-Flows relevant. Teams bei diesem Uebergang zu helfen, ist Teil unserer Arbeit, und genau deshalb fanden wir diesen Fall als konkretes Beispiel aufschlussreich. Wenn das die Art von Ansatz ist, die Sie suchen, sprechen Sie mit uns .