Viele Menschen denken bei KI-Faehigkeit an eine Wahl zwischen verschiedenen Tools oder Modellen. In der Praxis zaehlt die Faehigkeit des Operators mehr. Zwei Personen koennen dasselbe Tool nutzen und sehr unterschiedliche Ergebnisse bekommen, weil eine weiss, wie die Arbeit strukturiert werden muss, und die andere nicht.

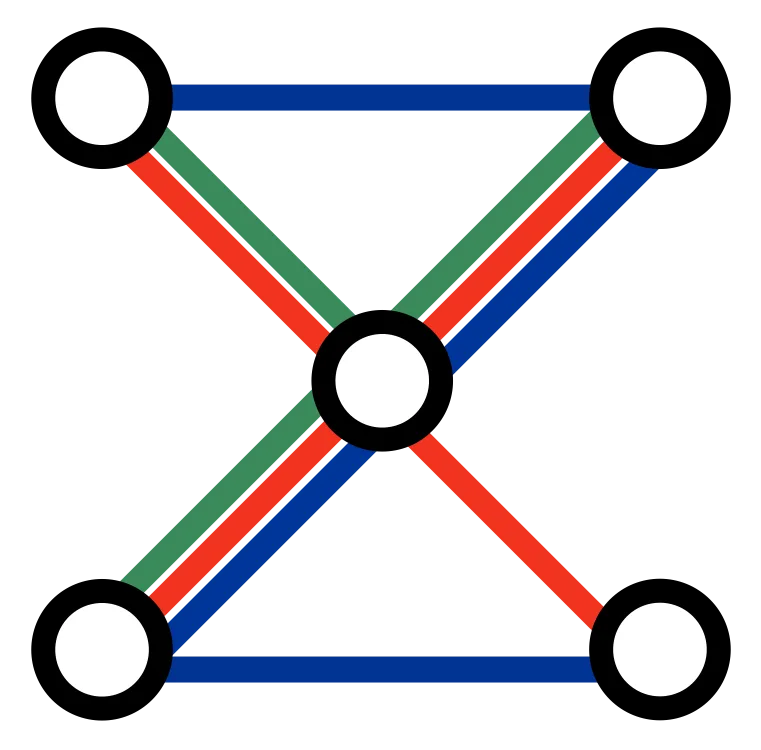

Der Schritt vom Prompting zu bedeutet, eine Abfolge von Faehigkeiten zu lernen. Abkuerzungen funktionieren hier nicht wirklich. Man kann die Tools wechseln, aber man muss trotzdem lernen, wie man sie einsetzt. Viele dieser Tools sehen fuer Nutzer, die in dieser Lernkurve noch nicht weit sind, auch ziemlich aehnlich aus. Dieser Artikel betrachtet die Faehigkeiten, die Menschen brauchen, um mit agentischen Workflows wirksam zu werden, und wie jede auf der vorherigen aufbaut. Rollenspiele ordnen Faehigkeiten oft in einem Tree. Man beginnt mit grundlegenden Faehigkeiten und schaltet mit der Zeit fortgeschrittene frei. Genau so laesst sich agentische Arbeit ebenfalls sinnvoll betrachten.

Fuer die meisten Nutzer ist das Problem nicht der Zugang zu Tools. Kein Produkt liefert von allein verlaessliche Ergebnisse. Man muss lernen, wie man fragt, wonach man fragt, wann man korrigiert und wie man wiederholbare Resultate erzeugt. KI-Systeme geben einem oft genau das, wonach man gefragt hat, auch wenn die Antwort falsch ist. Halluzinationen, schwache Verankerung in Quellen und falsche Sicherheit sind nach wie vor haeufig. Gute Operatoren erkennen und korrigieren diese Fehlermuster konsequent.

Der Skill Tree

Die meisten Nutzer starten am unteren Ende dieser Entwicklung, weil sie genau das bereits kennen. Sie haben ChatGPT oder aehnliche Tools genutzt, um Fragen zu stellen, Dokumente zusammenzufassen oder Texte zu entwerfen. Sie haben aber auch die Grenzen gesehen: ueberzeugend klingende Antworten, die falsch sind, fehlende Quellen, schwache Verankerung und Outputs, die auseinanderfallen, sobald die Aufgabe konkreter wird. Die naechste Ebene beginnt dann, wenn Nutzer KI nicht mehr als One-shot Antwortmaschine behandeln, sondern ihr begrenzte Aufgaben, besseren Kontext und klarere Review-Kriterien geben. Von dort aus bewegt sich die Entwicklung in Richtung wiederholbarer Workflows, delegierter Systeme und Veraenderungen daran, wie Teams die Arbeit selbst organisieren.

Es ist ausserdem immer noch frueh. Viele KI-Nutzer bauen diese Faehigkeiten gerade erst auf, und ein grosser Teil des Marktes ist weiterhin experimentell. Je weiter man in dieser Entwicklung nach oben kommt, desto weniger ausgereift wirkt die Erfahrung oft. Das gilt besonders fuer Tools, die vor allem fuer Nutzer gebaut sind, die noch am unteren Ende des Skill Trees arbeiten.

Bei XYZ by FORMATION helfen wir Menschen und Teams dabei, agentische Workflows pragmatisch einzufuehren und echten Arbeitsfortschritt zu erzielen. Wir haben viel Zeit damit verbracht, die Faehigkeiten in diesem Baum zu testen, verschiedene Tools auszuprobieren und zu lernen, was in welchem Kontext funktioniert und was noch rau ist.

flowchart TD

subgraph L0["One-Shot Prompting"]

direction LR

A1["Aufgaben-Definition"]

A2["Rollen-Prompting"]

A3["Few-shot Prompting"]

A4["Quellenrecherche"]

A5["Nach Zitaten fragen"]

A6["Antworten pruefen"]

A7["Halluzinationen erkennen"]

A8["Output spezifizieren"]

end

subgraph L1["Einfache Agents"]

direction LR

B1["Aufgaben zerlegen"]

B2["Kontext verpacken"]

B3["System Prompts"]

B4["Agent-Anweisungen"]

B5["Tool-Auswahl"]

B6["Datei- und Repo-Verankerung"]

B7["Ablauf planen"]

B8["Artefakte pruefen"]

end

subgraph L2["Workflows und "]

direction LR

C1["Workflow-Design"]

C2["Guard-Rail-Design"]

C3["Strukturierte Outputs"]

C4["Eval-Design"]

C5["Retry- und Fallback-Logik"]

C6["Freigabe-Gates"]

C7["State- und Memory-Design"]

C8["Planung und Alerting"]

end

subgraph L3["Delegation und Kontrolle"]

direction LR

D1["Delegations-Design"]

D2["Rollen-Design"]

D3["Supervisor-Patterns"]

D4["Kontext-Handoffs"]

D5["Freigabe-Routing"]

D6["Berechtigungs-Design"]

D7["Queue-Design"]

D8["Eskalationspfade"]

end

subgraph L4["Organisatorische Transformation"]

direction LR

E1["Funktionen neu gestalten"]

E2["Workflow-Verantwortung"]

E3["Governance"]

E4["Operator-Training"]

E5["Change Management"]

E6["Kosten- und Risikokontrollen"]

E7["Funktionsuebergreifende Integration"]

E8["Capability-Rollout"]

end

A1 --> B1 --> C1 --> D1 --> E1

A2 --> B2 --> C2 --> D2 --> E2

A3 --> B3 --> C3 --> D3 --> E3

A4 --> B4 --> C4 --> D4 --> E4

A5 --> B5 --> C5 --> D5 --> E5

A6 --> B6 --> C6 --> D6 --> E6

A7 --> B7 --> C7 --> D7 --> E7

A8 --> B8 --> C8 --> D8 --> E8

B2 --> C7

B3 --> C2

B5 --> C4

B6 --> C3

C4 --> D3

C5 --> D8

C6 --> D5

C7 --> D4One-Shot Prompting

Das ist die gewoehnliche ChatGPT-artige Nutzung: einen Artikel anfragen, ein Thema recherchieren, eine Frage beantworten, ein Dokument zusammenfassen oder Optionen brainstormen. Die Arbeit ist weiterhin meist ein einzelner Lauf oder nur leicht iterativ. Das Modell soll nicht lange autonom arbeiten oder einen Prozess steuern.

Faehigkeiten auf dieser Ebene:

- Aufgaben-Definition: festlegen, was das Modell tun soll und was es ignorieren soll

- Rollen-Prompting: dem Modell eine nuetzliche Haltung geben, ohne so zu tun, als waere Rollenspiel allein schon die Methode

- Few-shot Prompting: mit Beispielen zeigen, welches Muster gewuenscht ist

- Quellenrecherche: die richtigen Dokumente, Referenzen und Annahmen einbringen

- nach Zitaten fragen: nach nachvollziehbarer Stuetzung fragen statt nach glatt klingenden, unbelegten Behauptungen

- Antworten pruefen: kontrollieren, ob der Output die Frage tatsaechlich beantwortet

- Halluzinationen erkennen: selbstsichere Erfindungen und schwache Verankerung erkennen

- Output spezifizieren: nach einer nutzbaren Struktur fragen statt nach einem Textblock

Was Menschen hier meist uebersehen: Gutes Prompting ist kein einzelner Trick. Es ist ein Buendel kleiner Operator-Gewohnheiten. Diese Ebene bringt Geschwindigkeit. Sie bringt noch keine Verlaesslichkeit oder Hebelwirkung.

Einfache Agents

Hier beginnt agentische Arbeit. Der Nutzer fragt nicht mehr nur nach Text, sondern gibt dem System begrenzte Jobs: tiefe Recherche, kleine Skripte, UI-Prototypen, Repo-Inspektion, strukturierte Entwuerfe. Der Wechsel besteht darin, nicht mehr nur nach einer Antwort zu fragen, sondern einen Job zu vergeben.

Faehigkeiten auf dieser Ebene:

- Aufgaben zerlegen: eine grosse Anfrage in begrenzte Schritte aufteilen, die der Agent wirklich abschliessen kann

- Kontext verpacken: die Dateien, Screenshots, Beispiele und Referenzen bereitstellen, von denen der Lauf abhaengt

- System Prompt Design: dauerhaftes Verhalten und Prioritaeten definieren, bevor der Lauf startet

- Agent-Anweisungen schreiben: dem Agent sagen, wie gutes Ergebnis aussieht, wie weit er gehen darf und wann er stoppen soll

- Tool-Auswahl: die richtigen Tools waehlen und den Agent zuerst pruifen lassen, bevor er handelt

- Datei- und Repo-Verankerung: die Arbeit in den tatsaechlichen Dokumenten, im Code oder in den betroffenen Assets verankern

- Ablauf planen: den Agent die Arbeit sinnvoll sequenzieren lassen, statt chaotisch durch Tools zu springen

- Artefakte pruefen: nach einem pruefbaren Skript, Entwurf, Prototyp oder Bericht fragen statt nach undurchsichtigem Output

Vibe Coding gehoert hierhin. Es liefert Prototypen-Geschwindigkeit, aber keine Produktionsdisziplin. Andrej Karpathys Vibe coding MenuGen beschreibt beide Seiten gut: enorme Geschwindigkeit am Anfang, dann Reibung, sobald echte Engineering-Anforderungen auftauchen.

Was Menschen hier meist uebersehen, ist Context Engineering. Der Agent ist nur so gut wie die Job-Grenze, die Anweisungen und die Materialien, die man ihm gibt. Hier passen Tools wie Claude Cowork Setup , Codex Setup , Agentic Slides , Proposal and RFP Assistant , Meeting Prep and Decision Pack und Due Diligence Room Assistant hinein.

Workflows und Guard Rails

Jetzt wird die Arbeit mit Checks, Timing und Standards umhuellt. Der Operator jagt nicht mehr isolierten Erfolgen hinterher. Er baut eine wiederholbare Routine, die den Einsatz im echten Betrieb ueberlebt.

Faehigkeiten auf dieser Ebene:

- Workflow-Design: entscheiden, wo der Agent startet, was er tut und was als erledigt gilt

- Guard-Rail-Design: Einschraenkungen, Checklisten und verbotene Aktionen festlegen, bevor die Ausfuehrung beginnt

- strukturierte Outputs: Ergebnisse in Formen zwingen, die nachgelagerte Schritte verlaesslich pruefen koennen

- Eval-Design: Rubriken, Fehlerschwellen und Testfaelle festlegen, statt sich auf Geschmack zu verlassen

- Retry- und Fallback-Logik: entscheiden, was erneut versuchen darf, was sauber degradieren soll und was stoppen muss

- Freigabe-Gates: festlegen, wo Menschen pruefen, freigeben oder ablehnen

- State- und Memory-Design: festlegen, was sich der Workflow zwischen Laeufen merken soll und wo dieser Zustand gespeichert wird

- Planung und Alerting: entscheiden, was im Takt laufen soll, was unterbrechen darf und was auf Review warten muss

Hier werden Closing the Loop und The End of Notifications direkt relevant. Hier passen auch Services wie Agentic Content Management , Sales Follow-Up Operator , Pipeline Review Copilot , Board Pack Copilot , Exec Briefing Agent , Investor Update Engine , SEO Manager , QA Tester , Security Officer und Webmaster hinein.

Was Menschen hier meist uebersehen: Verlaesslichkeit entsteht durch Design ausserhalb des Prompts. Diese Ebene bringt Verlaesslichkeit.

Delegation und Kontrolle

An diesem Punkt geht es nicht mehr um einen Agent und eine Aufgabe. Es geht um Zerlegung, Routing, Freigaben und Handoffs ueber Rollen, Systeme und Menschen hinweg.

Faehigkeiten auf dieser Ebene:

- Delegations-Design: entscheiden, was delegiert werden soll, was lokal bleiben soll und was nie autonom sein darf

- Rollen-Design: Arbeit in spezialisierte Agents und menschliche Verantwortungen zerlegen

- Supervisor-Patterns: eine koordinierende Rolle nutzen, um Arbeit zu pruefen, zu routen und zu begrenzen

- Kontext-Handoffs: Kontextuebergaben zwischen Menschen, Tools und Kanaelen steuern, ohne kritischen Zustand zu verlieren

- Freigabe-Routing: entscheiden, welche Schritte handeln duerfen, welche Review brauchen und welche nur beraten

- Berechtigungs-Design: Tool- und Datenzugriff an die Rolle binden, statt pauschal Macht zu vergeben

- Queue-Design: Ausnahmen, Triage und Verantwortlichkeit steuern, wenn sich Arbeit staut

- Eskalationspfade: entscheiden, was passiert, wenn Vertrauen sinkt, Risiko steigt oder ein Workflow haengen bleibt

Hier passen OpenClaw Setup , Engineering Team Agentic Setup , Agentic Website , Market Intelligence und Company-Wide Agentic Workflow hinein. Ebenso passen Why Code-Centric AI Workflows Will Outperform Traditional Business Tools und How AI Can Pull Dev and Ops Teams Out of DevOps Hell sauber in die Argumentation.

Agentic Engineering gehoert hierhin. Die Arbeit dreht sich um Harness-Design, Tool-Berechtigungen, Review-Oberflaechen, Interface-Vertraege, Queues und Fehlerbehandlung. OpenAIs Harness engineering: leveraging Codex in an agent-first world und Simon Willisons How coding agents work sind starke Referenzen fuer diesen Wechsel.

Organisatorische Transformation

Hier hoert KI auf, nur eine Produktivitaetsschicht zu sein, und beginnt zu veraendern, wie die Arbeit organisiert ist. Die Frage lautet nicht mehr, ob ein einzelner Workflow gut funktioniert. Die Frage lautet, ob sich eine Funktion um agentische Systeme herum neu gestalten laesst, mit klarer Verantwortung, Kontrollen, Budgets, Training und Fehlerbehandlung als Teil des normalen Betriebs.

Faehigkeiten auf dieser Ebene:

- Funktionen neu gestalten: eine Geschaeftsfunktion so umformen, dass die Arbeit durch eine gesteuerte agentische Struktur laufen kann

- Workflow-Verantwortung: festlegen, wer Ergebnisse, Fehler, Budgets und Verbesserungen verantwortet

- Governance: Kontrollen, Reporting, Auditierbarkeit und Ausnahmebehandlung rund um live laufende autonome Arbeit definieren

- Operator-Training: Menschen darin schulen, diese Systeme zu betreiben, zu pruefen und zu verbessern

- Change Management: Anreize, Gewohnheiten und Interfaces veraendern, statt KI nur auf alte Gewohnheiten aufzusetzen

- Kosten- und Risikokontrollen: Ausgaben, Modellrisiko, Sicherheit und Compliance als operative Einschraenkungen behandeln

- funktionsuebergreifende Integration: Handoffs, Anreize und Systemgrenzen ueber Teams hinweg abstimmen statt nur innerhalb eines Workflows

- Capability-Rollout: Veraenderung sequenzieren und das Modell ausweiten, ohne die Kontrolle zu verlieren

Hier geht es bei den Services nicht mehr um ein einzelnes Setup, sondern um operative Neugestaltung. Small Autonomous Organization und Complex Autonomous Organization machen aus einer Funktion eine gesteuerte operative Einheit. Company-Wide Agentic Workflow veraendert, wie ein Team in der Praxis zusammenarbeitet. Company-Wide Agentic Deep Dive ist der breitere Transformationsschritt ueber mehrere Funktionen hinweg. Roadmap Agentic Review und Your Agentic Use Case helfen dabei zu entscheiden, wo diese Neugestaltung beginnen sollte.

Faehigkeiten, die in den 28 Services verborgen sind

FORMATION XYZ bietet rund 30 Services, die Unternehmen beim Einstieg in KI unterstuetzen. Damit dieser Katalog leichter zu lesen ist, kennzeichnen wir Services als Starter, Intermediate und Advanced. Diese Labels sind keine Produktstufen. Sie sind eine Kurzform fuer die Operator-Faehigkeiten, die ein Team braucht, um einen Service gut zu nutzen und auch nach dem initialen Setup weiter Wert daraus zu ziehen.

Genau darum geht es beim Skill Tree. Ein Service ist nicht nur etwas, das wir liefern und dann hinter uns lassen. Er ist auch ein Mechanismus fuer den Transfer von Faehigkeiten. Wenn ein Team einen Workflow kauft, aber nie lernt, Aufgaben zu rahmen, Kontext zu verpacken, Output zu pruefen, Guard Rails zu entwerfen oder Handoffs zu steuern, dann bleibt der Workflow auf externe Hilfe angewiesen und verschlechtert sich mit der Zeit.

Unsere Arbeit besteht deshalb ebenso aus Coaching und Vermittlung wie aus der Unterstuetzung bei der Automatisierung. Ein Unternehmen zu betreiben ist Teamarbeit. Der langfristige Gewinn ist nicht ein cleverer Workflow. Der Gewinn besteht darin, dass die Menschen im Unternehmen ihr Urteil, ihre Arbeitsgewohnheiten und ihre praktischen KI-Faehigkeiten weiterentwickeln, damit sich die Systeme auch nach unserem Einsatz weiter verbessern.

Deshalb darf KI-Arbeit auch nicht als Nebenaufgabe fuer die juengste Person im Raum behandelt oder als Neuheit an einen Praktikanten delegiert werden. Die nuetzlichen Zugewinne entstehen dann, wenn die Menschen, denen die Arbeit gehoert, lernen, die Systeme rund um diese Arbeit zu betreiben. Vertriebsleitungen muessen Review-Loops und Handoff-Qualitaet verstehen. Engineering-Leitungen muessen Kontext, Berechtigungen und Harness-Design verstehen. Operatoren muessen wissen, wann sie einem System vertrauen koennen, wann sie es pruefen muessen und wann sie es stoppen muessen.

Der Servicekatalog laesst sich also am besten als eine Sammlung von Einstiegspunkten in den Skill Tree lesen. Manche Services helfen einem Team dabei, grundlegende Prompting- und begrenzte Agent-Faehigkeiten aufzubauen. Andere helfen dabei, in Workflows, Freigaben, Evals und wiederkehrende Operationen hineinzuwachsen. Die fortgeschrittensten Services drehen sich nicht mehr wirklich um KI-Tooling. Sie helfen einem Unternehmen dabei, neu zu gestalten, wie Arbeit verantwortet, geprueft und verbessert wird.

Was das in der Praxis bedeutet

Die Kernaussage dieses Skill Trees ist einfach: Der Wert von KI steigt mit den Faehigkeiten des Operators. Die echten Gewinne entstehen dann, wenn Teams ueber isolierte Einzelerfolge hinausgehen und Gewohnheiten, Workflows und Urteilsfaehigkeit aufbauen, die gute Ergebnisse wiederholbar machen.

Wenn Ihr Team noch im One-shot Prompting steckt, ist das ein vollkommen legitimer Startpunkt. Wenn Sie bereits begrenzte Aufgaben mit einfachen Agents bearbeiten koennen, ist der naechste Schritt meist, Workflows mit Guard Rails, Evals, Freigaben und wiederkehrender Review hinzuzufuegen. Und sobald diese Muster funktionieren, verschiebt sich die Chance erneut: weg von isolierten Use Cases und hin zur Neugestaltung von Verantwortung, Kontrollen und Teamroutinen rund um agentische Systeme, denen man vertrauen kann.

Genau dort setzt FORMATION XYZ an. Wir helfen Teams dabei, nuetzliche Arbeit zu automatisieren, aber auch die Faehigkeiten aufzubauen, die noetig sind, um diese Arbeit gut zu betreiben. Das Ziel ist nicht, Sie mit einem cleveren Setup allein zu lassen, das nur funktioniert, solange wir im Raum sind. Das Ziel ist, Ihre Menschen so weiterzuentwickeln, dass die Systeme Teil der Arbeitsweise Ihres Unternehmens werden.

Wo Sie beginnen, haengt davon ab, wo Ihr Team heute steht und was am dringendsten verbessert werden muss. Der Hype um OpenClaw ist gerade enorm, und das aus gutem Grund. Menschen erreichen damit wirklich transformative Ergebnisse. Aber es bringt auch reale Risiken und echte Fehlermuster mit sich. OpenClaw ist nicht einfach nur eine Tool-Installation. Es zwingt Teams sehr schnell in Delegation, Kontrolle und organisatorische Neugestaltung hinein, was bedeutet, dass es einen grossen Teil des Skill Trees sofort sichtbar macht.

Genau deshalb liegt der Wert von etwas wie OpenClaw nicht nur darin, dass das Tool laeuft. Der Wert besteht darin, dass es Ihrem Team einen ernsthaften Weg gibt, sich die Haende mit KI schmutzig zu machen, Operator-Urteilsfaehigkeit aufzubauen und sich durch die Ebenen von Faehigkeit zu arbeiten, die groessere Transformationen erst moeglich machen. Fuer manche Teams ist das der richtige Startpunkt. Fuer andere ist es sinnvoller, mit Claude Cowork fuer Dokument- und Research-Workflows oder mit Codex fuer repo-zentrierte und technische Workflows zu beginnen und sich dann nach oben zu bewegen. Und nicht jedes Team muss mit einem Starter-Paket anfangen. Vielleicht laufen Ihre bevorzugten Tools bereits und Sie suchen nach dem naechsten Schritt in Ihrer agentischen Entwicklung.

Sehen Sie sich unsere Services an. Schauen Sie, welche davon gerade am relevantesten wirken. Melden Sie sich dann bei uns. Wir helfen Ihnen, das Wesentliche einzugrenzen, den richtigen Startpunkt zu finden und Ihr Team in Bewegung zu bringen.

Mehr dazu

Dieser Artikel ist Teil einer groesseren Argumentation auf dieser Website. In Closing the Loop argumentieren wir, dass nuetzliche KI-Systeme nicht einfach Generatoren sind. Sie sind Schleifen mit Checks, Korrekturen und Kontrollpunkten. In The End of Notifications treiben wir das weiter und argumentieren, dass gute Systeme Unterbrechungen reduzieren sollten, statt mehr davon zu erzeugen.

Why Code-Centric AI Workflows Will Outperform Traditional Business Tools erklaert, warum strukturierte Dateien, Repositories und pruefbare Umgebungen so wichtig sind, wenn Agents echte Arbeit leisten sollen. How AI Can Pull Dev and Ops Teams Out of DevOps Hell zeigt, wie das in der operativen Praxis aussieht, wenn der eigentliche Gewinn darin besteht, Fixes, Checks und in wiederverwendbare Systeme zu verwandeln.

Wenn Sie die Geschwindigkeitsseite dieser Geschichte interessiert, zeigen Hyper Agile und What if time to market was measured in hours or days instead of months or years? , was passiert, wenn Teams den Zyklus von der Idee bis zum Launch auf Stunden oder Tage komprimieren koennen. Wenn Sie die vorsichtigere Seite interessiert, argumentiert The NRC affair shows why newsrooms need skills, not just AI tools , dass schwache Operator-Urteilsfaehigkeit nicht einfach verschwindet, nur weil ein Modell beteiligt ist.